Rovnoměrné rozdělení (česky)

V běžném životě se setkáváme s procesy, u kterých není snadné předem určit, jak dopadnou. Pokud se tento problém převede do světa matematiky, tak se jedná o jevy, u kterých nejsme schopni předem s jistotou určit, jaký z možných výsledků nastane. Takto predikovat výsledek není často možné z důvodu, že je sledovaný jev příliš složitý a komplexní, nebo o něm nejsou známy všechny potřebné informace, tj. jeho výsledek je určen nějakou náhodou. Pro lepší představu je možné si pod těmito jevy představit různé experimenty, testy, přírodní jevy apod.[1]

Touto problematikou se zabývá teorie pravděpodobnosti. Ta se snaží tuto náhodu určit matematicky. Výsledkům pokusů přiřazuje jejich pravděpodobnost, která udává podíl případů, kdy nastane daný výsledek. Na základě těchto jednoduchých modelů je pak možné řešit složitější problémy.[1]

Například: Máme k dispozici vyváženou (nebo také spravedlivou) minci. Za pomoci této mince můžeme spočítat, jaká je pravděpodobnost, že nám z 2000 hodů padne 100 orlů. Zde je důležité specifikovat, že se jedná o vyváženou (nebo také spravedlivou) minci. Kdyby nebyla mince vyvážená, padala by panna nebo orel častěji a tento experiment by tím byl značně zkreslen.

Contents

- 1 Termilonogie

- 2 Rovnoměrné rozdělení

- 3 Reference

Termilonogie

Veškeré popsané definice by měly být popsány v kapitole Opáčko ze statistiky: Pravděpodobností rozdělení nebo Pravděpodobnostní rozdělení. Jelikož je opakování matka moudrosti, budou zde v krátkosti popsány základní definice z teorie pravděpodobnosti, které nejsou stoprocentně pokryty ve výše zmíněných kapitolách.

Experiment, pravděpodobnostní prostor a náhodný jev

Na začátku je třeba matematicky definovat, co znamená jev a experiment. Jev je možné popsat jako množinu, které se bude přiřazovat pravděpodobnost. Experiment je poté definován jako pravděpodobnostní prostor, který je určen jako trojice:

kde Ω obsahuje všechny výsledky určitého experimentu, Ϝ označuje kolekci všech možných jevů, kterým je možné přiřadit pravděpodobnost P.

Náhodný jev A je možné chápat jako množinu elementárních jevů, tedy nějakou podmnožinu A z množiny Ω.[1]

Například: Hod dvěma vyváženými mincemi – množinově vyjádřený jev, že padne alespoň jednou panna P (orel značen O). Prostor elementárních jevů je Ω = {(P, P), (P, O), (O, P), (O, O)}. Sledovaný jev A tedy bude: A = {(P, P), (P, O), (O, P)} tj. podmnožina množiny Ω.

Pro takto množinově definovaný jev je možné používat množinové operace jako je sjednocení a průnik dvou a více množin nebo opačný jev k jevu A.[1]

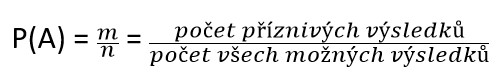

Klasická definice pravděpodobnosti

Za klasickou definici pravděpodobnosti je možné považovat tu, kterou zformoval francouzský matematik Pierre-Simon Laplace na přelomu 18. století a je definována takto:

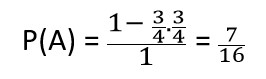

P(A) značí pravděpodobnost sledovaného jevu A (například zmíněný hod mincí), která je rovna podílu příznivých výsledků a všech možných výsledků. Definice předpokládá, že se jedná o konečný počet výsledků několika vzájemně různých pokusů, které jsou všechny stejně pravděpodobné (viz poznámka o vyvážené minci).[1]

Například: Pozorovaný jev A je hod vyváženou mincí. Zajímá nás, jaká je pravděpodobnost, že padne orel? Mince má dvě strany, na jedné je panna a na druhé orel. Všechny možné výsledky jsou 2 a nás zajímá pouze orel. Výsledkem je tedy 0,5, tj. 50% šance, že padne orel.

Jelikož je možné vyjádřit pravděpodobnost procenty, je její hodnota v rozmezí mezi 0 % a 100 %, to jest výsledek podílu výše je mezi 0 a 1 a současně platí, že je maximálně 1. Toto vychází z definice pravděpodobností míry (viz kapitola níže). Toto je možné jednoduše vysvětlit na příkladu s vyváženou mincí.

Pravděpodobnost, že padne orel, je stejná jako, že padne panna. Toto jsou jediné dva výsledky, které mohou nastat. Pokud sečtu pravděpodobnosti všech možných výsledků, dostanu hodnotu 1 (0,5 + 0,5 = 1).

Vedle této klasické definice pravděpodobnosti, je možné v jiných textech nalézt jiné definice (například dle A. N. Kolmogorova, axiomatickou, statistickou či geometrickou). Pro jednodušší vysvětlení rovnoměrného rozdělení je zde uvedena ještě jedna definice a to grafická.[1][2][3]

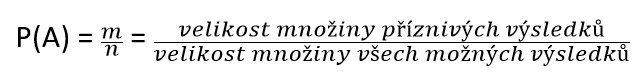

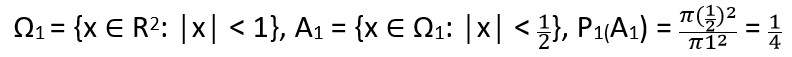

Grafická definice pravděpodobnosti

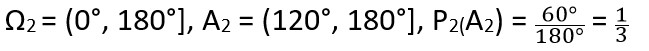

Grafická definice pravděpodobnosti nahlíží na sledovaný jev A z hlediska jeho relativní velikosti. Předpokládá, že výsledky tohoto jevu nastávají v nějakém geometrickém objektu či množině o konečné velikosti (například plochy, délky, objemu, apod.), kde je každý tento výsledek stejně pravděpodobný. Pravděpodobnost tohoto jevu A je poté definována takto:

Stejně jako je napsáno u klasické definice pravděpodobnosti, je analogicky odůvodnitelné, že součet pravděpodobností všech výsledků je 1, tj. maximální velikost množiny (plochy) je 1.[1]

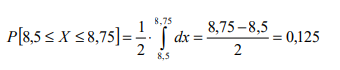

Například: Romeo a Julie se mají setkat na tajném místě mezi polednem a 1 hodinou odpoledne. Každý z nich dorazí v náhodném okamžiku v tomto určeném čase a počká zde pouze 15 minut. Pokud ten druhý nedorazí, odejde. Jaká je pravděpodobnost, že se potkají?

Celková plocha je 1. Vybarvená oblast odpovídá situacím, kdy se setkají. Pravděpodobnost, že se potkají je následující:

Pro určení výsledku byla použita pravděpodobnost opačného jevu a nezávislosti dvou pozorovaných jevů.[1]

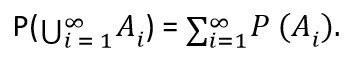

Pravděpodobnostní míra

Pravděpodobnostní míra na (Ω, Ϝ) je funkce P: F → R (F je zobrazení na množinu reálných čísel) splňující:

1) nezápornost: pro každé A ∈ F platí P(A) ≥ 0,

2) normalizace: P(Ω) = 1,

3) σ – aditivita: když jsou A1, A2 … ∈ F vzájemně disjunktní jevy (Ai ∩ Aj = ∅ pro ∀i, j: i ≠ j), tak

Z této definice plyne, že pro každé A ∈ F platí 0 ≤ P(A) ≤ 1. Jak již bylo zmíněno výše, pravděpodobnost je možné uvádět v procentech tj. 0 % až 100 %. Je nutné správně definovat volbu P a to, co je myšleno pod pojmem „náhodný“. Vágně zadaný příklad může vést k paradoxům.[1]

Například: Bertrandův paradox – Náhodná tětiva X na jednotkové kružnici. Jaká je pravděpodobnost P(A), kde A = {│x│ > l} a l je strana libovolného vepsaného rovnostranného trojúhelníku? Zde záleží na tom, co je míněno pod slovem „náhodná“:

1) Vybereme rovnoměrně náhodně střed x:

2) Vybereme rovnoměrně náhodně úhlovou velikost a směr tětivy x viděné ze středu:

3) Vybereme rovnoměrně náhodně vzdálenost tětivy x od středu a směr:

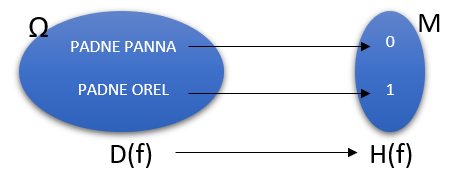

Náhodné veličiny

Výsledkem náhodného experimentu často nebývá číslo. Aby bylo možné takové experimenty matematicky zpracovat, je vhodné každému výsledku přiřadit jeho číselnou hodnotu. Vhodným přiřazením je výběr informace, která je pro nás zajímavá. Toto přiřazení je možné provést několika způsoby, proto je nazýváno náhodnou veličinou a značí se X, Y, apod.[1][3][4]

Například: Počítání orlů při hodu vyváženou mincí: X(orel) = 1, X(panna) = 0. Toto přiřazení je vyobrazené na obrázku níže.

Matematicky je definice stanovená takto: Náhodná veličina X na pravděpodobnostním prostoru (Ω, F, P) je funkce, která každému výsledku experimentu ω ∈ Ω přiřadí hodnotu X(ω) ∈ R a pro kterou platí podmínka měřitelnosti:

Podmínka měřitelnosti říká, že {X ≤ x} je náhodný jev, u kterého je možné spočítat jeho pravděpodobnost.[1]

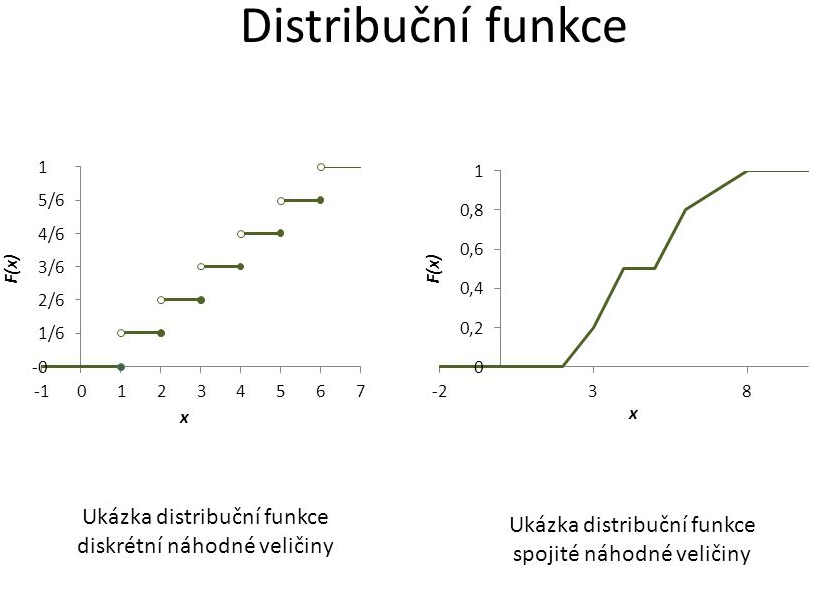

Distribuční funkce

Distribuční funkce určuje pravděpodobnost, že náhodná veličina nabude hodnoty menší než x případně hodnoty x. Lze ji formálně definovat takto: Funkci FX : R → R definovanou vztahem FX(x) = P(X ≤ x) nazýváme distribuční funkcí náhodné veličiny X.

Základními vlastnostmi distribuční funkce jsou, že nabývá hodnot z intervalu, je neklesající, je zprava spojitá (zde záleží na konkrétní definici, může být spojitá zleva) a má nejvýše spočetně mnoho bodů nespojitosti.[4]

Hustota pravděpodobnosti

Protože v některých případech nabývá náhodná veličina nespočetně mnoha hodnot (například měření času, vzdálenosti, apod.), není možné přiřadit kladnou pravděpodobnost P(X = x) každé hodnotě, protože by se nespočetné množství takových pravděpodobností nasčítalo na nekonečno. Proto je každé jednotlivé hodnotě přisouzena nulová pravděpodobnost. Je třeba měřit pravděpodobnost intervalů. Intuitivně je zřejmé, že pravděpodobnost, že budu čekat na tramvaj nebo autobus přesně 3 minuty je nulová. Hustotu pravděpodobnosti f(x) spojité náhodné veličiny je možné popsat jako reálnou nezápornou funkci takovou, že ve všech bodech, kde existuje derivace distribuční funkce platí, že plocha pod křivkou hustoty pravděpodobnosti je rovna 1.[4]

Další důležité pojmy

Další důležité pojmy jako střední hodnota, rozptyl a kvantily jsou popsány v kapitole Opáčko ze statistiky: Pravděpodobností rozdělení nebo Pravděpodobnostní rozdělení..

Pravděpodobnostní rozdělení

Pravděpodobnostní rozdělení nebo rozložení náhodné proměnné udává, jaká je pravděpodobnost, že náhodná veličina bude mít zrovna danou hodnotu. Náhodné veličiny dělíme na diskrétní a spojité. Diskrétní náhodná veličina nabývá jednotlivých hodnot jako například 0 jako panna nebo 1 jako orel při hodu mincí nebo hodnoty 1 až 6 při hodu kostkou. Spojité nabývají hodnot na spojité škále, tj. nějaké intervaly. Příkladem může být váha novorozence, doba čekání na autobus, apod.

Diskrétní rozdělení

Náhodné veličiny X se nazývají diskrétní, pokud nabývají pouze hodnot z nějaké nejvýše spočetné množiny {x1, x2, x3 … xk}, kde k = 1, 2, 3, 4, … n ∈ N. Pravděpodobnosti možných hodnot náhodné veličiny X jsou P(X = xk), kde k = 1, 2, 3, 4, … n ∈ N. Tuto pravděpodobnost P(X = xk) je možné chápat jako funkci x, kterou je možné nazvat pravděpodobnostní funkcí nebo diskrétní hustotou náhodné veličiny X. Nenulovou pravděpodobnost mají pouze ty hodnoty xk, kterých náhodná veličina X nabývá.

Mezi nejznámější příklady diskrétních náhodných veličin jsou:[5]

1) Bernoulliho (nebo také Alternativní) rozdělení

2) Binomické rozdělení

3) Geometrické rozdělení

4) Poissonovo rozdělení

Spojitá rozdělení

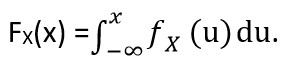

Náhodné veličiny X se nazývají spojité, pokud existuje nezáporná funkce fX taková, že pro každé x ∈ R můžeme vyjádřit distribuční funkci FX jako

Funkci fX v takovémto případě odpovídá hustotě pravděpodobnosti náhodně veličiny.[1]

Mezi nejznámější příklady spojitých náhodných veličin jsou:[5]

1) Rovnoměrné rozdělení

2) Exponenciální rozdělení

3) Normální rozdělení

4) Logaritmicko-normální rozdělení

5) Cauchyovo rozdělení

6) Studentovo t-rozdělení

Rovnoměrné rozdělení

Rovnoměrné rozdělení je jedno z nejjednodušších rozdělení. Toto rozdělení má pro všechny hodnoty náhodné veličiny stejnou pravděpodobnost. Může být zaraženo, jak mezi diskrétními, tak i spojitými náhodnými veličinami.

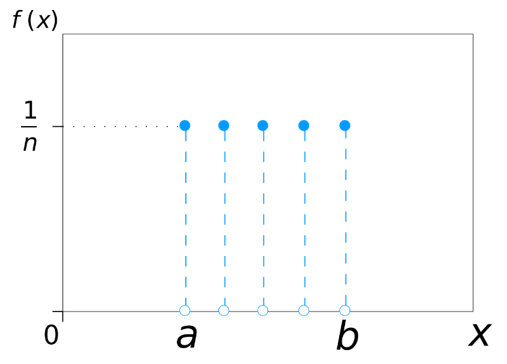

Diskrétní rovnoměrné rozdělení

Toto rozdělení popisuje náhodnou veličinu, která může nabývat n různých hodnot, které mají stejnou pravděpodobnost Failed to parse (MathML with SVG or PNG fallback (recommended for modern browsers and accessibility tools): Invalid response ("Math extension cannot connect to Restbase.") from server "https://en.wikipedia.org/api/rest_v1/":): {\displaystyle \frac{1}{n}} . Předpokládá se, že vzdálenost mezi těmito hodnotami náhodné veličiny je stejná. Toto rozdělení představuje jedno z nejjednodušších případů diskrétního rozdělení.

Typickým příkladem diskrétního rovnoměrného rozdělení je hod šestistěnnou hrací kostkou, kdy pravděpodobnost padnutí každého z čísel je Failed to parse (MathML with SVG or PNG fallback (recommended for modern browsers and accessibility tools): Invalid response ("Math extension cannot connect to Restbase.") from server "https://en.wikipedia.org/api/rest_v1/":): {\displaystyle \frac{1}{6}} .[6]

Tato kapitola se dále věnuje spojitému rovnoměrnému rozdělení.

Spojité rovnoměrné rozdělení

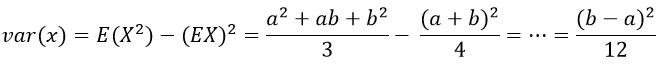

Rovnoměrné rozdělení, které se značí X ∼ U(a,b), má dva parametry – a jako minimální hodnotu a b jako maximální hodnotu, kde a a b jsou z intervalu −∞ < a < b < ∞.[1]

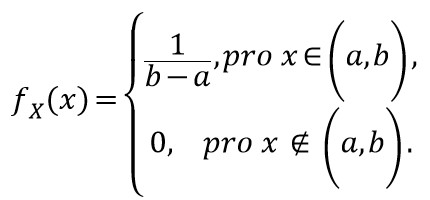

Definice

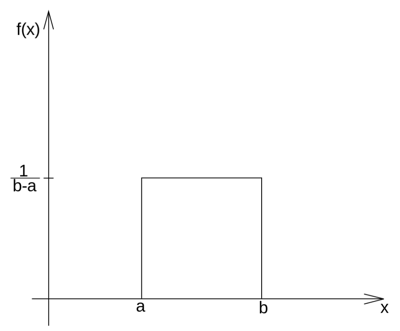

Náhodná veličina X má rovnoměrné (uniformní) rozdělení na intervalu (a,b), kde a < b, pokud je její hustota pravděpodobnosti na tomto intervalu konstantní. Je vyjádřena vztahem:

Takto vypadá graf hustoty pravděpodobnosti spojitého rovnoměrného rozdělení:

Vlastnosti

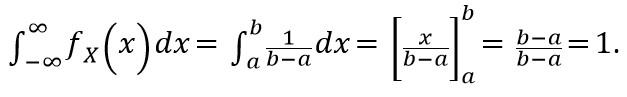

Jednou z vlastností tohoto rozdělení je, že hodnota plochy pod grafem hustoty je 1. Mimo daný interval (a, b) je tedy hustota pravděpodobnosti nulová. Toto je možné snadno ověřit:[1]

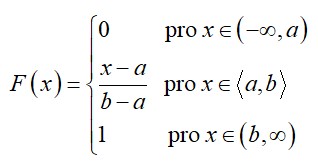

Distribuční funkce rovnoměrného rozdělení je následující:

Takto vypadá graf distribuční funkce spojitého rovnoměrného rozdělení:[7]

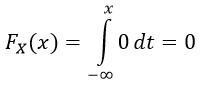

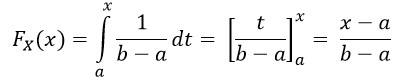

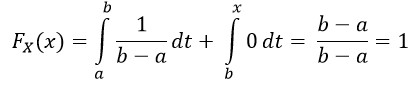

Vyjádření distribuční funkce lze snadno odvodit ze základní vlastnosti distribuční funkce a hustoty pravděpodobnosti:

1) pro x ∈ (-∞, a):

2) pro x ∈ [a, b]:

3) pro x ∈ (b, ∞):

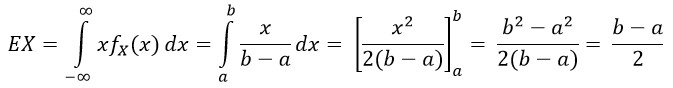

Střední hodnotu (aritmetický průměr) EX je možné odvodit následovně:

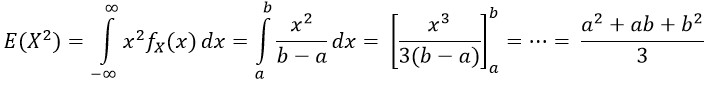

Rozptyl je průměrem druhých mocnin odchylek jednotlivých hodnot od aritmetického průměru z hodnot statistického souboru. Je možné ho zapsat vzorcem var X = E(X2) – (EX)2. Pro odvození rozptylu, je třeba nejdříve zjistit E(X2):

Ze střední hodnoty X2 je možné odvodit rozptyl následovně:

Souhrn všech důležitých vlastností a vzorečků

Řešené příklady

Příklad 1: Tramvajová linka číslo 8 odjíždí v dopoledních hodinách ze zastávky každých 10 minut. Vypočtěte pravděpodobnost, že na ni budete dopoledne čekat déle než 7 minut.[7]

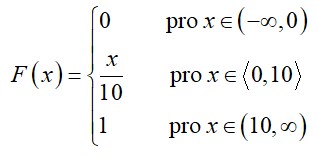

Řešení: Doba čekání je náhodná veličina X, která má rovnoměrné rozdělení pravděpodobnosti - v tomto případě X ∼ U(0, 10). Distribuční funkce má tedy tvar:

Hledaná pravděpodobnost:

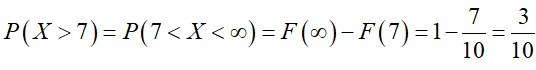

Příklad 2: Prodejna očekává dodávku nového zboží určitý den v době od 8 do 10 hodin. Podle sdělení dodavatele je uskutečnění dodávky stejně možné kdykoliv během tohoto časového intervalu. Jaká je pravděpodobnost, že zboží bude dodáno v době od půl deváté do tři čtvrtě na devět?[8]

Řešení: X ∼ U(8, 10).

Reálné aplikace

Jelikož je pravděpodobnost rovnoměrného rozdělení snadno vypočitatelná, existuje tedy řada dalších aplikací, pro které lze toto rozdělení použít, jak je uvedeno níže, je ho možné využít pro situace při testování hypotéz, případy náhodného vzorkování, finance, atd. Dále obecně platí, že pro experimenty fyzikálního původu, je možné taktéž využít rovnoměrného rozdělení (např. emise radioaktivních částic).[9][10]

Dále je toto rozdělení možné použít také pro příklady typu doba čekání do nastoupení určitého jevu, který se opakuje v pravidelných intervalech, nebo chyby při zaokrouhlování v numerických výpočtech. Zaokrouhlují-li se čísla na k desetinných míst, lze chybu ze zaokrouhlování považovat za náhodnou veličinu s rovnoměrným rozdělením na intervalu <-5.10-k-1; 5.10-k-1>.[8]

Ekonomický příklad

V oblasti ekonomiky nemusí poptávka a doplňování zboží obvykle odpovídat očekávanému normálnímu rozdělení. Výsledkem je, že se k lepší předpovědi pravděpodobností a trendů používají jiné distribuční modely, jako je Bernoulliho proces. V případě zkoumání doby pro správu zásob na začátku, kdy se analyzuje zcela nový produkt, se ukazuje jako užitečnější rovnoměrné rozdělení. V této situaci nemusí být jiné rozdělení použitelné, protože o novém produktu neexistují žádná stávající data nebo není k dispozici historie poptávky, takže ve skutečnosti neexistuje vhodné nebo známé rozdělení. (Rovnoměrné rozdělení by bylo v této situaci ideální, protože náhodná proměnná, která souvisí s poptávkou, není u nového produktu známa, ale výsledky se pravděpodobně budou pohybovat mezi přijatelným rozsahem dvou hodnot.) Toto by tedy představovalo vhodnou náhodnou proměnnou. Z modelu rovnoměrného rozdělení je možné vypočítat další faktory související s dobou realizace. Další výhodou použití rovnoměrného rozdělení je jeho jednoduchost.[11]

Chyba kvantování

Při analogově-číslicovém převodu dojde k chybě kvantování. Tato chyba je způsobena zaokrouhlením nebo zkrácením. Když je původní signál mnohem větší než jeden nejméně významný bit (LSB), chyba kvantování významně nekoreluje se signálem a má přibližně rovnoměrné rozdělení. Chyba RMS tedy vyplývá z rozptylu této distribuce.[12]

Funkce v Excelu

V excelu pro toto rozdělení není funkce, která by šla použít přímo.

Příklady pro studenty k procvičení

Příklad 1: Náhodná veličina X má rovnoměrné rozdělení. Jaká je její hustota, jestliže EX = 1, var X = 3?

Příklad 2: Dělník obsluhuje v dílně 4 stroje. U prvního stroje stráví 10 minut, u druhého 25 minut, u třetího 15 minut a u čtvrtého 10 minut, poté se opět vrací k prvnímu stroji. Určete pravděpodobnost, že přijdeme-li do dílny v náhodný okamžik, zastihneme ho u třetího stroje.

Reference

- ↑ 1.00 1.01 1.02 1.03 1.04 1.05 1.06 1.07 1.08 1.09 1.10 1.11 1.12 1.13 BLAŽEK, Rudolf B., Roman KOTECKÝ, Daniel VAŠATA, Jitka HRABÁKOVÁ a Petr NOVÁK. BI-PST - Pravděpodobnost a statistika: Přednáška. Praha, 2018.

- ↑ JOSEF, Tošenovský. Teorie pravděpodobnosti [online]. Ostrava, 2012 [cit. 2021-5-22]. Dostupné z: http://www.person.vsb.cz/archivcd/FMMI/PST/Teorie%20pravdepodobnosti.pdf. Učební text. Vysoká škola báňská – Technická univerzita Ostrava.

- ↑ 3.0 3.1 KULICH, Michal. Souhrn teorie pravděpodobnosti: Pro obor Finanční matematika [online]. Praha, 2013 [cit. 2021-5-22]. Dostupné z: https://www2.karlin.mff.cuni.cz/~pesta/NMFM301/pravdepodobnost_fm.pdf. Učební text. Matematicko-fysikální fakulta University Karlovy.

- ↑ 4.0 4.1 4.2 ŠVECOVÁ, Jarmila. Náhodná veličina [online]. [cit. 2021-5-22]. Dostupné z: https://slideplayer.cz/slide/2734327/%C2%A8. Prezentace.

- ↑ 5.0 5.1 PESTA. Přehled pravděpodobnostních rozdělení [online]. praha, 2009 [cit. 2021-5-22]. Dostupné z: https://www2.karlin.mff.cuni.cz/~pesta/NMFM301/rozdeleni.pdf. Učební text. Matematicko-fysikální fakulta University Karlovy.

- ↑ CORPORATE FINANCE INSTITUTE. Uniform Distribution: A form of probability distribution where every possible outcome has an equal likelihood of happening [online]. [cit. 2021-5-22]. Dostupné z: https://corporatefinanceinstitute.com/resources/knowledge/other/uniform-distribution/

- ↑ 7.0 7.1 OTI73.5. ZÁKLADNÍ TYPY ROZDĚLENÍ PRAVDĚPODOBNOSTI SPOJITÉ NÁHODNÉ VELIČINY [online]. [cit. 2021-5-22]. Dostupné z: https://homel.vsb.cz/~oti73/cdpast1/KAP05/PRAV5.HTM. Učební text. Vysoká škola báňská – Technická univerzita Ostrava.

- ↑ 8.0 8.1 GLÜCKSMANNOVÁ, Radka. PRAVDĚPODOBNOSTNÍ MODELY KOLEM NÁS [online]. České Budějovice, 2007 [cit. 2021-5-22]. Dostupné z: http://home.ef.jcu.cz/~mrkvicka/vyuka/Pmkn.pdf. Bakalářská práce. Jihočeská univerzita v Českých Budějovicích. Vedoucí práce RNDr. Tomáši Mrkvičkovi, Ph.D.

- ↑ Johnson, Roger (1994), Estimating the Size of a Population, Teaching Statistics, 16 (2 (Summer)): 50–52, CiteSeerX 10.1.1.385.5463, doi:10.1111/j.1467-9639.1994.tb00688.x

- ↑ Walpole, Ronald; et al. (2012). Probability & Statistics for Engineers and Scientists. Boston, USA: Prentice Hall. pp. 171–172. ISBN 978-0-321-62911-1.

- ↑ Wanke, Peter (2008). The uniform distribution as a first practical approach to new product inventory management. International Journal of Production Economics. 114 (2): 811–819. doi:10.1016/j.ijpe.2008.04.004 – via Research Gate.

- ↑ NEZNÁMÝ. Quantization (signal processing) [online]. [cit. 2021-5-22]. Dostupné z: https://en.wikipedia.org/wiki/Quantization_(signal_processing)#Error.